Téměř po stejně dlouhou dobu, po kterou existují počítače, pracují inženýři na vývoji lepších způsobů interakce lidí s technologiemi. Až do nedávného zavedení dotykové obrazovky představovala většina rozhraní mezi lidmi a počítači kompromis mezi jednoduchým použitím a granulárním řízením. Dotyková obrazovka pak nabídla mnohem přirozenější a intuitivnější způsob ovládání, které lehce zvládnou i děti.

Ovšemže dotykové obrazovky nejsou ideální pro každou aplikaci. Zvyšují náklady u levných aplikací, je náročné je používat na menších zařízeních, představují slabé místo v případě venkovních instalací, a to jak ze strany klimatických vlivů, tak ze strany vandalů, navíc mohou ohrozit bezpečnost a k interakci pochopitelně potřebují fyzickou blízkost člověka. V takových případech potřebují návrháři najít způsob, jak lze intuitivně ovládat technologie bez těchto nedostatků. U podobných aplikací by hlasové rozpoznávání a ovládání hlasem mohlo představovat ideální technologii.

Na myšlence ovládat technologie pouze hlasem není nic nového. Od úsvitu počítačového věku byla učiněna řada pokusů využít tímto způsobem sílu řeči. Tyto pokusy byly různě úspěšné. Až v nedávné době však došlo k propojení velkého pokroku v algoritmech rozpoznávání řeči s rozsáhlým výpočetním výkonem. Tato skutečnost návrhářům umožnila navrhnout technologii, která na obrovskou škálu příkazů reaguje rychle a přesně.

První pokus o vytvoření počítače schopného rozumět lidské řeči byl učiněn v roce 1952 firmou Bell Laboratories. Systém nazvaný Audrey byl velice primitivní a dokázal porozumět jen několika málo číslům, která vyslovovali konkrétní lidé.

Rozpoznávání řeči se postupně zlepšovalo až do sedmdesátých let, kdy Ministerstvo obrany Spojených států amerických spustilo program DARPA Speech Understanding Research (SUR). DARPA SUR byl obrovský projekt, který probíhal od roku 1971 do roku 1976. Zmiňovaný výzkum nakonec vedl k vývoji systému Harpy na Univerzitě Carnegie Mellon. Tento systém již disponoval slovníkem obsahujícím více než 1 000 slov. Spíše než o vývoj dřívějších systémů šlo v případě systému Harpy o zavedení průlomového přístupu ve vyhledávání, který byl mnohem efektivnější než předchozí vyhledávací systémy. Paprskové prohledávání umožňovalo předpovědět konečnou síť možných vět.

V osmdesátých letech došlo k obrovskému posunu v rozpoznávání řeči díky vývoji Skrytého Markovova modelu (HMM), statistické modelovací techniky, která uměla předpovídat, zda jednotlivé zvuky mohou být slova. Díky tomuto pokroku se značně rozšířil počet slov, která se počítač byl schopen naučit, na několik tisíc. Další obrovský technologický pokrok přišel v roce 1997, kdy byl spuštěn první systém schopný porozumět přirozenému řečovému projevu. Dragon Naturally Speaking dokázal zpracovat asi 100 slov za minutu.

Všechny tyto průlomové okamžiky vytvořily základ pro rozpoznávání řeči. K tomu, aby se tato technologie stala součástí hlavního proudu, musely ve velkém měřítku existovat levné, široce dostupné počítače, schopné za účelem ovládání reagovat v reálném čase. K tomu došlo nedávno, a sice díky dvěma gigantům z oboru, společnostem Google a Apple.

Společnost Apple uvedla v roce 2011 na trh inteligentního digitálního osobního asistenta Siri prostřednictvím chytrého telefonu iPhone 4S. Siri povýšila systém uživatelského ovládání o další úroveň. Uživatelům umožnila prostřednictvím hlasového ovládání telefonovat přátelům, diktovat zprávy nebo přehrávat hudbu. V roce 2012 aplikace Google Voice Search, která byla původně vyvinuta pro Apple iPhone, využila možnosti vlastního připojení telefonů k porovnání vyhledávaných frází s množstvím dat z vyhledávání uskutečněných uživateli, která společnost nashromáždila v cloudu. Možnost porovnání s předchozími vyhledáváními měla za následek obrovský skok v úrovni přesnosti, protože umělé inteligenci (AI) umožnila lépe porozumět kontextu vyhledávání. Vyhledávání Google Search i Siri ve skutečnosti představovaly sekundární způsob ovládání, tj. po dotykové obrazovce. Na další úroveň pak posunula hlasové ovládání společnost Amazon a její Echo, kde došlo ke spojení digitálního osobního asistenta s reproduktorem a k upuštění od dotykového displeje.

Díky úspěchu inteligentních digitálních osobních asistentů považuje stále více návrhářů i amatérů hlasové rozpoznávání a ovládání hlasem za pravděpodobnou možnost dalšího vývoje svých návrhů. Tuto myšlenku podpořil i analytik z ABI Research, který odhaduje, že se do roku 2021 bude každoročně dodávat 120 milionů hlasových zařízení a ovládání hlasem bude klíčovým uživatelským rozhraním v rámci chytré domácnosti.

Návrháři, kteří chtějí začlenit ovládání hlasem do nějakého produktu, musí zvážit několik věcí. Je možné vybudovat celý systém od základů, který by fungoval offline, ale to by umožňovalo pouze relativně omezenou funkčnost. Algoritmy a knihovny pro rozpoznávání řeči by byly limitovány pamětí a implementace nových příkazů by byla obtížná. Možné to však je. PocketSphinx byl vyvinut pro zařízení se systémem Android a nejnovější verzi lze použít jako samostatnou aplikaci na jakémkoli zařízení se systémem Android Wear 2.0.

Většina vývojářů však bude chtít nabídnout ucelenější instrukční sadu, což bude vyžadovat připojení ke cloudu. Většina velkých poskytovatelů cloudu, včetně společností Amazon a Google, nabízí hlasové nástroje jako službu. A lze je relativně levně začlenit do návrhů. Stejně jako u každého rozhodnutí o návrhu bude volba optimální služby záviset na vašich vlastních prioritách. Například společnost IBM také nabízí hlasovou službu jako součást platformy Watson Cloud. Tato platforma je flexibilní, ale je zajímavější spíše pro ty, kteří chtějí využít analytických znalostí IBM, než pro ty, kteří chtějí obecnější platformu zaměřenou na spotřebitele.

Společnosti Amazon i Google nabízejí platformu, která je přizpůsobena obecnému trhu automatizace domácností. Obě tyto společnosti daly dohromady ekosystém, který zahrnuje některé z nejrespektovanějších vývojářů produktů automatizace domácností. Mezi partnery společnosti Amazon najdeme zařízení od společností Nexia, Philips Hue, Cree, Osram, Belkin či Samsung. Společnost Google má řadu stejných partnerů jako Amazon, například Hive, Nest, Nvidia, Philips Hue či Belkin.

Za účelem snazšího začlenění ovládání hlasem do produktů společností Amazon a Google nabídly obě tyto společnosti přístup ke svým platformám za relativně nízkou cenu. Služba Alexa Voice Service (AVS) vývojářům umožňuje přímou integraci Alexa do svých produktů. AVS poskytuje kompletní sadu zdrojů včetně API, SDK, sad pro vývoj hardwaru a dokumentace.

Také firma Google vývojářům umožňuje využívat funkce inteligentního digitálního osobního asistenta Google Assistant prostřednictvím SDK. Nástroj Google Assistant SDK nabízí dvě možnosti integrace asistenta Google Assistant: knihovnu Google Assistant a rozhraní Google Assistant gRPC API. Knihovna Google Assistant je napsána v jazyce Python a je podporována na zařízeních s architekturou linux-ARM v7l a linux-x86_64 (např. počítače Ubuntu a Raspberry Pi 3 B). Knihovna nabízí API vysoké úrovně založené na událostech, které lze snadno rozšířit. V případě gRPC API Google Assistant nabízí přístup k API nízké úrovně. Vazby u tohoto API lze generovat pro jazyky jako Node. js, Go, C++, Java, a to pro všechny platformy podporující gRPC.

Pro ty, kteří by se těmto službám raději vyhnuli nebo použili open source rozhraní, jsou k dispozici i další možnosti. Například Mycroft je volný, open source inteligentní osobní asistent pro operační systémy založené na systému Linux, který používá uživatelské rozhraní přirozeného jazyka. Mycroft je také modulární aplikace, která umožňuje uživatelům měnit své komponenty. Jinou open source možností je Jasper, který vývojářům umožňuje do softwaru snadno přidávat nové funkce.

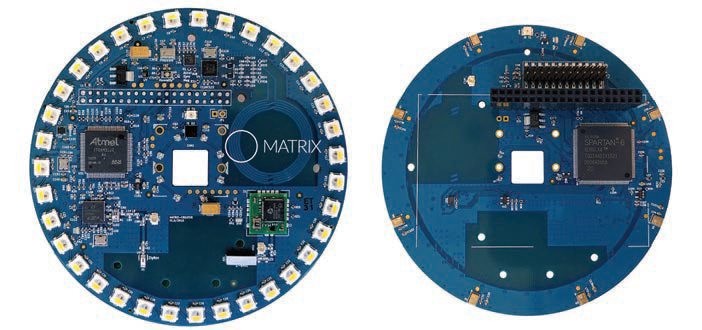

Pokud jde o hardware, nejpravděpodobnějším hostitelem bude počítač s jednou deskou, jako je Raspberry Pi. Existují některé desky, které byly navrženy speciálně pro aplikace ovládání hlasem, jako je třeba deska Matrix Creator, která může fungovat buď jako Raspberry Pi Hat, nebo jako samostatná jednotka. Deska obsahuje sestavu sedmi mikrofonů MEMS, které jí poskytují 360° poslechové pole. Desku pohání ARM Cortex M3 s pamětí 64 Mbit SDRAM. Vestavěna je také řada senzorů dovolující vývojářům zvýšit funkčnost. Mezi předem hotové, běžně dostupné služby, které lze použít s deskou, patří Amazon AVS, Google Speech API a Houndify.

Velmi důležitým konstrukčním prvkem jsou pochopitelně mikrofony. Více mikrofonů, často uspořádaných v určité sestavě, se často používá k přesnějšímu zachycení zvuku. Pokud technologie pro poskládání zvuku z různých mikrofonů není zabudována do určité sestavy, může to znamenat dodatečné konstrukční práce a procesní výkon. Také technologie redukce šumu je extrémně důležitá k zajištění přesného příjmu instrukcí.

Svatý grál pro vývojáře znamená stvořit co možná nejintuitivnější rozhraní mezi lidmi a stroji. Doposud neexistuje jediné, které by bylo srovnatelné se způsobem, kterým mezi sebou komunikují lidé – instinktivně. Ovládání hlasem se nyní nachází ve fázi, kdy se tento proces jeví téměř stejně přirozený jako mluvení s jiným člověkem. Ačkoli tuto technologii razily některé z největších společností z oboru, je nyní dostupná všem vývojářům, kteří ji mohou používat ve svých vlastních projektech. Vzhledem k tomu, že velká část vlastního zpracování probíhá v cloudu, hardwarové nároky nejsou až tak vysoké, jak by se dalo předpokládat. Existují také specializované desky, nástroje a služby, které jsou široce dostupné a znamenají dramatické zjednodušení procesu, což má za následek, že lze ovládání hlasem přidat téměř do každého projektu.